Smart ProductionDie industrielle Bildverarbeitung wird intelligent

Im Gegensatz zur klassischen Bildverarbeitung braucht Künstliche Intelligenz (KI) keine programmierbaren Regeln. Das erleichtert vielfach den Einsatz.

Was ist KI?

Der Begriff künstliche Intelligenz war ein Einfall von John McCarthy vom MIT, als er im Vorfeld der Dartmouth Conference im Sommer 1956 mit einem Förderantrag an die Rockefeller Foundation Eindruck schinden wollte.

Zu Anfang sah man KI als Allheilmittel an, mit dem sich alle Probleme mit BV, Robotersteuerungen usw. in Luft auflösen würden. Im Gegensatz zum Menschen kann eine KI – mit entsprechender Rechenleistung ausgestattet – sehr schnell sehr viel lernen. Und speziell bei der Mustererkennung ist KI unschlagbar.

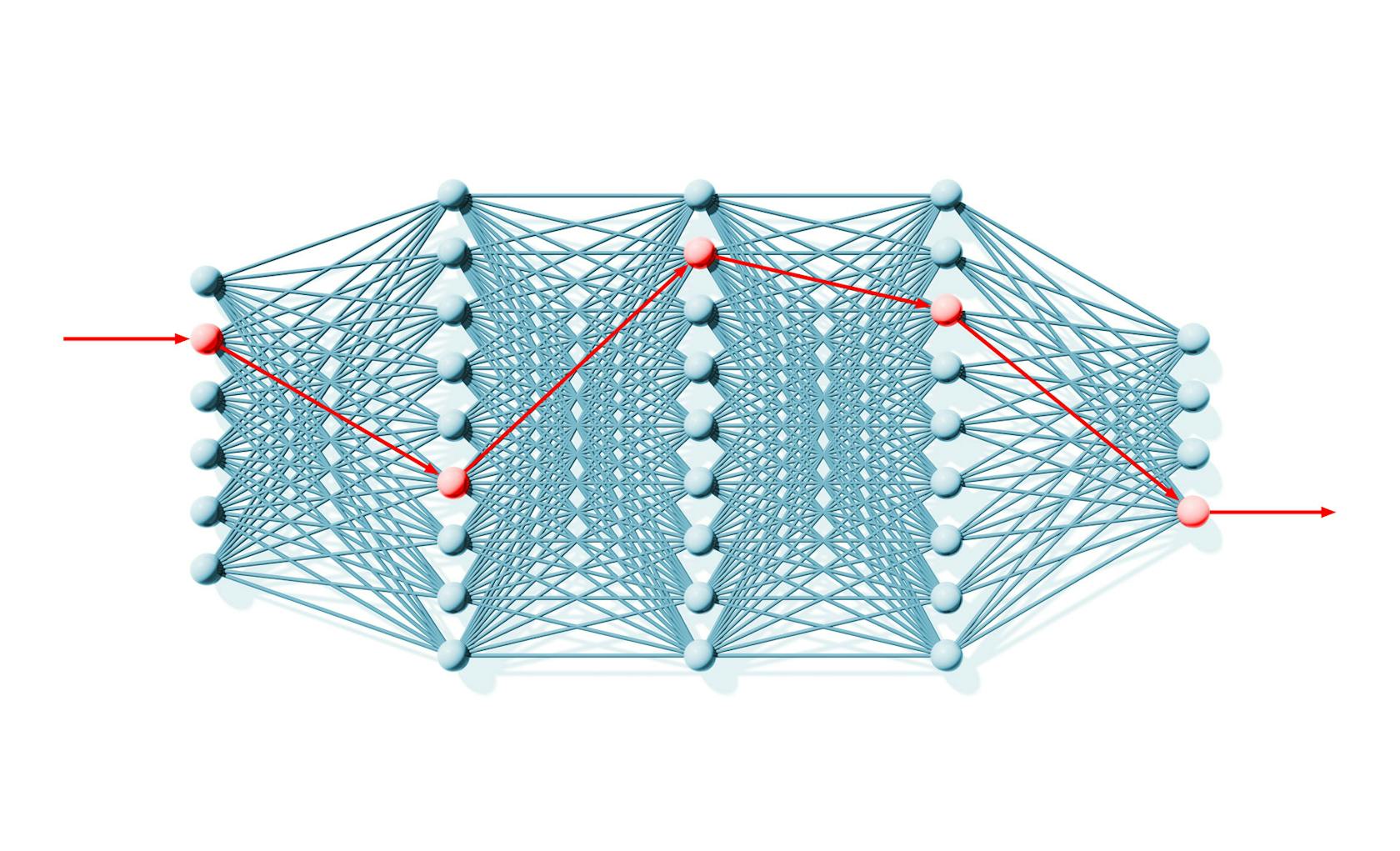

KI basiert auf Neuronalen Netzen (NN). Die Neuronen entsprechen den Nervenzellen und Gliazellen eines menschlichen Gehirns, die über Synapsen miteinander verbunden sind. Ohne auf biologische Details einzugehen, Nervenzellen alleine sind nicht wirklich intelligent. Intelligent sind sie im Zusammenspiel mit anderen Nervenzellen.

Die Neuronen der KI sind Computer-Programme, die Informationen empfangen, verarbeiten und an weitere Neuronen versenden, die dann ihrerseits die Informationen verarbeiten und versenden usw. Mit Trainingsdaten lernt KI nun welcher Weitergabeweg ergebnisabhängig der jeweils richtige ist. Kommen dann neue Daten, wendet das Netz diese Gewichtung an und liefert die richtigen Ergebnisse, solange die Trainingsdaten eindeutig und repräsentativ sind. Das Risiko im Einsatz von NN besteht darin, dass man hinterher nicht mehr nachvollziehen kann, warum eine Entscheidung gefällt wurde. Einen Menschen kann man fragen, warum er einen Hund als Wolf gesehen hat, ein NN nicht.

Um nun Bilddaten mit höherer Genauigkeit verarbeiten zu können, reichen einfache NNs nicht aus. Convolutional Neural Networks (gefaltete Neuronale Netze oder CNN) bestehen aus komplexen Schichten von Neuronen.

Typische Fragestellungen für diese CNN sind dann:

- Klassifikation (Erkennen einer Klasse von Objekten)

- Multi Objekterkennung (Erkennen einer Vielzahl von gleichartigen Elementen)

- Mehrfach Klassifikation (Unterscheidung zwischen mehreren Klassen)

- Anomaliedetektion (Abweichung zu einer Referenz entdecken)

- Segmentierung (Aufteilung in verschiedene Bereiche, z.B. Vordergrund vs. Hintergrund)

KI braucht Big Data zum Lernen

Zum Training benötigt KI Bilddaten. Beim Klassifizieren wird ein Bildbereich einer vorab definierten Klasse wie 'in Ordnung' oder 'nicht in Ordnung' zugeordnet. Um auch Feinheiten zu erkennen, "muss das System wie ein kleines Kind lernen, wie Kanten, Kreise, Farben, Strukturen etc. aussehen. In der 'Lehrlingszeit' lernt KI dann, wie z.B. eine Schweißnaht aussieht", fasst Marian Schlüter, vom Bereich Automatisierungstechnik/Abteilung Maschinelles Sehen am Fraunhofer IPK zusammen.

Eine Variante des Lernens von NN ist überwachtes Lernen (supervised learning). Hier bekommt das System die gewünschte Lösung und das Netzwerk verändert solange seine Parameter, bis es hinreichend gut das gewünschte Ergebnis liefert. Beim bestärkenden Lernen (reinforcement learning) erfährt das System nur, ob die produzierte Lösung besser oder schlechter als die vorangegangene ist. Durch „Bestrafungen“ und „Belohnungen“ werden die Systemparameter optimiert.

Beim selbstorganisierten Lernen (unsupervised learning) erfährt das System nicht, ob seine Lösung richtig ist. Diese Netze klassifizieren Informationen gemäß Ähnlichkeiten zwischen den Daten. So lassen sich z.B. unbekannte Defekte auf Bauteilen entdecken.

Egal welche Methode und welches Netz man einsetzt, den Aufwand darf man nicht unterschätzen. Erste Ergebnisse lassen sich sehr schnell erreichen. Jedoch hohe Genauigkeiten brauchen Zeit.

Der Aufwand für die Datenerfassung für KI erfordert nicht selten wochenlange Arbeit. Kommt aber ein bestimmter Fehler selten vor oder die entsprechende Maschine ist erst in der Entwicklung, fehlen mitunter aussagefähige Daten. Abhilfe schaffen hier Simulationen und das Vortrainieren der NN. So lassen sich z.B. aus CAD-Daten Testbilder erzeugen. Für das Vortrainieren der Netze stehen Bilddatensätze etwa wie ImageNet zur Verfügung. Danach reichen wenige Anwendungsbilder zur Feinabstimmung der Parameter.

Novelty Detection und Active Learning

Kommen neue Fehlerarten dazu, dann hilft Novelty Detection (Neuheitserkennung, Anomaly Detection). Dann reichen zum Training ausschließlich Bilder von Gutteilen.

Eine Weiterführung davon ist Active Learning. Fehlen in manchen Szenarien die ursprünglichen Trainingsbilder und nimmt man zum Training nur die neu hinzugekommenen, dann kann das Netz vergessen. „Es kann sogar passieren, dass ein NN dann gar nichts mehr weiß und nicht klassifizieren kann. Im Englischen wird das als „catastrophic forgetting“ beschrieben“, berichtet Marian Schlüter. Dagegen helfen aktives und inkrementelles Lernen, indem man z.B. Teilmengen der alten Datensätze für neue Trainings verwendet.

KI in der Industrie

KI in der BV ist gerade auf dem Weg in den industriellen Einsatz. Rauigkeit, Spiegelungen usw. von Bauteilen können KI noch aus dem Takt bringen.

Und auch auf der Hardwareseite für KI-Anwendungen passiert enorm viel. Wir müssen ja auch schauen, dass die Taktzeiten bei der BV in der Produktionslinie gehalten werden.

Die Frage der Performance werden wir in einem zukünftigen Beitrag noch einmal aufgreifen.

Es gibt (noch) meist psychologische Hinderungsgründe für den Einsatz von KI. "Firmen haben noch Vorbehalte, weil für sie KI eine Blackbox ist", so Marian Schlüter. Deshalb wird momentan viel im Bereich Explainable AI (erklärbare KI) geforscht, um nachvollziehbar zu machen, warum welche Entscheidungen getroffen wurden. Insbesondere in der Healthcare-Produktion mit der geforderten 100% Kontrolle ist das ein Thema. Information gibt es hier zu lesen.

Auch Nachhaltigkeit spielt hier herein. "Nicht alles was man mit KI machen kann, muss man auch damit machen, das braucht immens Rechenzeit und Energie", fast Marian Schlüter zusammen. So bleibt auch Platz für langbewährte Algorithmen der BV, aber KI wird sie verbessern.

In vielen Bereichen der Bildverarbeitungslösungen von VITRONIC spielt deshalb KI schon eine wichtige Rolle. Im nächsten Beitrag werden wir dies anhand unserer Schweißnahtlösung VIRO WSI genauer beleuchten.

Fazit

Kurz gesagt

- Zum Trainieren der KI werden große Datenmengen in hoher Qualität benötigt.

- KI in der BV ist gerade auf dem Weg in den industriellen Einsatz.

- Es bleibt Platz für langbewährte Algorithmen der BV, aber KI wird sie verbessern.